(本文节选自《生成式AI应用开发实战:基于智谱AI与DeepSeek》并稍做修改)

ReAct智能体,在当前阶段属于应用较为广泛的一种智能体类型。然而,在ReAct智能体之外,还存在着多种其他类型的智能体,诸如SelfAskWithSearch智能体、StructuredChat智能体,以及本文将要介绍的ConversationalChat智能体,即JSON格式聊天智能体。

JSON格式聊天智能体,顾名思义,是指采用JSON格式进行对话交流的智能体。此类智能体以JSON形式对生成式人工智能模型的输出进行格式化,从而使得输出结果更为结构化,易于应用程序后续进行解析与处理。简而言之,JSON格式聊天智能体的核心功能,在于对模型的输出进行格式化的处理,而不是像ReAct智能体那样通过特定的思维方式引导模型解决问题。

具体而言,JSON格式聊天智能体在接收用户输入后,会将其传递给生成式人工智能模型进行处理,此过程与其他应用程序或智能体并无差别,而其回复内容则会以JSON格式进行封装,即它会将传递给模型的问题和模型的响应成对整理封装到JOSN对象中,从而确保回复结构清晰、易于理解以及易于处理。这一特性使得JSON格式聊天智能体在对话系统、客户服务等各类聊天问答场景具有广泛的应用前景。

聊天问答的一个典型应用场景是智能知识库。智能知识库场景下的问答与普通模型问答的核心差异在于,对用户所提出的问题应当从知识库中查询寻找相关知识并将其归纳总结形成答案而不是根据模型已经内化知识进行推理回复。这一场景非常适合采用JSON格式聊天智能体实现。

智能知识库通过检索功能增强实现对已有知识的检索召回,如本书前述章节所述,检索功能增强又主要通过向量化技术实现。而向量化过程,既可以借助各生成式人工智能模型服务平台所提供的向量模型服务来完成,也可以通过在本地部署合适的向量模型来实现。本示例程序选择智谱AI所提供的向量模型Embedding-3作为实现向量化的支撑工具。

以下代码段实现智谱AI生成式人工智能模型GLM-4-plus与向量化模型Embedding-3的实例化过程。同时,为提供更为全面的参考,代码中还通过注释方式,展示在选用OpenAI相关模型时的实现代码示例。

import os

from dotenv import load_dotenv, find_dotenv

_ = load_dotenv(find_dotenv())

# from langchain_openai import ChatOpenAI, OpenAIEmbeddings

# llm = ChatOpenAI(temperature=0, model="gpt-4o")

# embeddings = OpenAIEmbeddings()

from langchain_community.chat_models import ChatZhipuAI

from langchain_community.embeddings import ZhipuAIEmbeddings

llm = ChatZhipuAI(model="glm-4-plus",

temperature=0.9,

)

embeddings = ZhipuAIEmbeddings(model="embedding-3")同一知识库中知识可以面向特定专一领域也可以同时包含多个领域,而其知识来源也可以是多源的。本示例程序纳入两个相对独立的知识领域——提示词工程与统一建模语言(UML),并且假定这两个领域知识来源方式不同:提示词工程知识源于本地文本文件,而UML知识则需通过互联网网页获取。

针对这两种不同数据源,处理流程大体一致。首先,将数据载入内存;接着,对数据内容进行切片和向量化处理;随后,将处理后的数据存储在向量库。最后,生成一个RetrievalQA对象实例,以便可将其作为工具对知识进行查询和检索。

以下是按照上述流程对本地文本文件进行处理的代码:

from langchain.chains import RetrievalQA

from langchain_chroma import Chroma

from langchain_text_splitters import CharacterTextSplitter

from langchain_community.document_loaders import TextLoader

doc_path = "./data/" + "大语言模型提示技巧.txt"

loader = TextLoader(doc_path, "utf-8")

documents = loader.load()

text_splitter = CharacterTextSplitter(

chunk_size=1000,

chunk_overlap=0

)

texts = text_splitter.split_documents(documents)

docsearch = Chroma.from_documents(

texts,

embeddings,

collection_name="prompt-skills"

)

doc_ret = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=docsearch.as_retriever()

)以下是按照上述流程对互联网网页进行处理的代码:

from langchain_community.document_loaders import WebBaseLoader

loader = WebBaseLoader("https://gtyan.com/archives/196")

docs = loader.load()

web_texts = text_splitter.split_documents(docs)

web_db = Chroma.from_documents(

web_texts, embeddings,

collection_name="UML-collection"

)

web_ret = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=web_db.as_retriever()

)在具备语义检索能力的检索工具准备完成后,即可开始编写智能体相关的代码。首先,需要完成提示词模板。本示例程序可直接采用LangChain提供的JSON格式聊天提示词模板(提示词具体内容可参考:https://smith.langchain.com/hub/hwchase17/react-chat-json),具体代码实现可采用hub拉取该模板。

from langchain import hub

prompt = hub.pull("hwchase17/react-chat-json")拉取提示词模板需要通过网络传输,会增加智能体运行延时及网络中断风险,为规避这两个问题也可以在代码中直接构建该提示词模板。

from langchain_core.prompts import ChatPromptTemplate, MessagesPlaceholder

system = '''Assistant is a large language model trained by OpenAI.

Assistant is designed to be able to assist with a wide range of tasks, from answering

simple questions to providing in-depth explanations and discussions on a wide range of

topics. As a language model, Assistant is able to generate human-like text based on

the input it receives, allowing it to engage in natural-sounding conversations and

provide responses that are coherent and relevant to the topic at hand.

Assistant is constantly learning and improving, and its capabilities are constantly

evolving. It is able to process and understand large amounts of text, and can use this

knowledge to provide accurate and informative responses to a wide range of questions.

Additionally, Assistant is able to generate its own text based on the input it

receives, allowing it to engage in discussions and provide explanations and

descriptions on a wide range of topics.

Overall, Assistant is a powerful system that can help with a wide range of tasks

and provide valuable insights and information on a wide range of topics. Whether

you need help with a specific question or just want to have a conversation about

a particular topic, Assistant is here to assist.'''

human = '''TOOLS

------

Assistant can ask the user to use tools to look up information that may be helpful in

answering the users original question. The tools the human can use are:

{tools}

RESPONSE FORMAT INSTRUCTIONS

----------------------------

When responding to me, please output a response in one of two formats:

**Option 1:**

Use this if you want the human to use a tool.

Markdown code snippet formatted in the following schema:

```json

{{

"action": string, \ The action to take. Must be one of {tool_names}

"action_input": string \ The input to the action

}}

```

**Option #2:**

Use this if you want to respond directly to the human. Markdown code snippet formatted

in the following schema:

```json

{{

"action": "Final Answer",

"action_input": string \ You should put what you want to return to use here

}}

```

USER'S INPUT

--------------------

Here is the user's input (remember to respond with a markdown code snippet of a json

blob with a single action, and NOTHING else):

{input}'''

prompt = ChatPromptTemplate.from_messages(

[

("system", system),

MessagesPlaceholder("chat_history", optional=True),

("human", human),

MessagesPlaceholder("agent_scratchpad"),

]

)随后,在着手构建智能体之前,一个必要的步骤是将先前已完成的RetrievalQA对象实例转化为Tool形式,以便智能体能够依据实际需求分析、生成并调用相应的指令。紧接着,使用函数create_json_chat_agent创建智能体,并在此基础之上,进一步使用该智能体对象实例化一个AgentExecutor执行器对象。上述过程相关代码如下。

from langchain.agents import AgentExecutor, Tool, create_json_chat_agent

tools = [

Tool(

name="prompt skills",

func=doc_ret.run,

description="当你需要回答关于提示词的相关问题时,使用此工具。输入的问题应当完整。",

),

Tool(

name="UML collection",

func=web_ret.run,

description="当你需要回答关于UML中集合的相关问题时,使用此工具。输入的问题应当完整。",

),

]

agent = create_json_chat_agent(

llm=llm,

tools=tools,

prompt=prompt

)

agent_executor = AgentExecutor(

agent=agent,

tools=tools,

verbose=False,

handle_parsing_errors=False

)至此,本示例程序已完成JOSN格式聊天智能体构建,包含上述所有部分的完整代码可参见源文件agent-vectorstore.py。

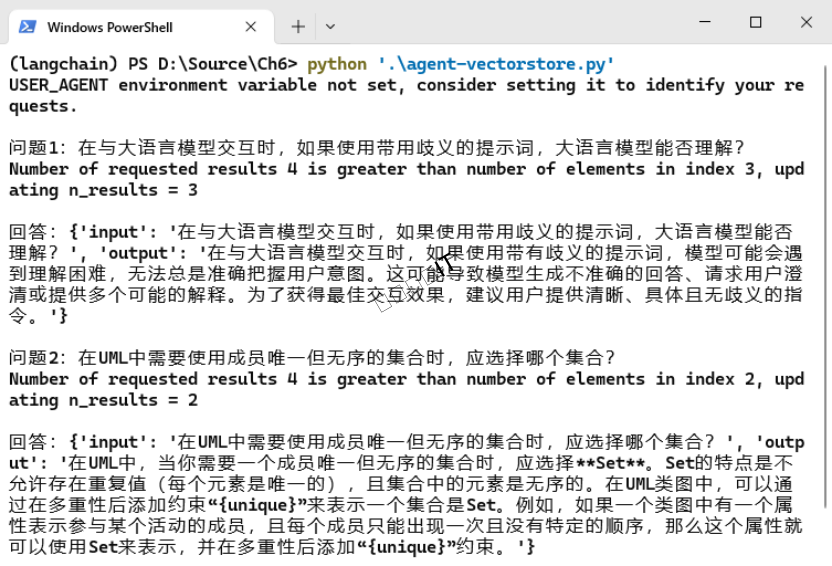

为验证智能体运行效果,可以继续添加类似如下测试代码:

question = "在与大语言模型交互时,如果使用带用歧义的提示词,大语言模型能否理解?"

print(f"\n问题1:{question}")

ae = agent_executor.invoke({"input": f"{question}"})

print(f"\n回答:{ae}")

question = "在UML中需要使用成员唯一但无序的集合时,应选择哪个集合?"

print(f"\n问题2:{question}")

ae = agent_executor.invoke({"input": f"{question}"})

print(f"\n回答:{ae}")运行添加上述测试代码之后的智能体,可以观察到其运行结果以结构化的JSON

格式进行返回,如图所示。

上述示例程序已经包含构建知识库的所有主要环节,面向实际应用场景时,需要根据知识不同来源调整或增加知识获取途径,由于知识内容体量也会比示例程序增加许多,向量数据库也需要更换为适宜在生产环境中的产品。

完整源代码参见:https://gitcode.com/gtyan/ISBN9787111782179/blob/main/Ch6/agent-SelfAskWithSearch.py